“Bernie vs. Claude” và ảo tưởng về một AI "khách quan”

“Bernie vs. Claude” và ảo tưởng về một AI "khách quan”

Bạn có nhận được câu trả lời khách quan từ AI? Có lẽ không, bạn đang nói chuyện với một "vai trò" mà AI đang đóng. Vai đó thay đổi theo từng cuộc hội thoại.

Bạn có nhận được câu trả lời khách quan từ AI? Có lẽ không, bạn đang nói chuyện với một "vai trò" mà AI đang đóng. Vai đó thay đổi theo từng cuộc hội thoại.

Một video tưởng như chỉ là một buổi podcast giữa Bernie Sanders và Claude lại mở ra một vấn đề sâu hơn: chúng ta có đang hiểu sai về cách AI tạo ra câu trả lời? Câu trả lời có thật sự khách quan, hay là một hệ thống phản chiếu ngữ cảnh, câu hỏi và kỳ vọng của người dùng, đôi khi nó có thể thay đổi lập trường chỉ vì cách ta đặt câu hỏi?

1. Chuyện gì đã xảy ra?

Ngày 19/03/2026, Thượng nghị sĩ Mỹ Bernie Sanders đăng một video lạ thường lên YouTube với tiêu đề "Bernie vs. Claude". Trong 9 phút, ông ngồi trước micro, đặt điện thoại lên giá đỡ, mở ứng dụng Claude của Anthropic, và "phỏng vấn" trực tiếp con AI này về quyền riêng tư.

Không phải tranh luận, không phải phiên điều trần. Cuộc nói chuyện của một thượng nghị sĩ 84 tuổi với chatbot, đạt hơn 4 triệu lượt xem với hơn 18.000 bình luận với nhiều phản ưng và tranh cãi.

Một bên tin rằng video là bằng chứng cho thấy AI thực sự nguy hiểm "chính AI cũng phải thừa nhận điều đó". Phía còn lại tin rằng video chỉ chứng minh AI rỗng tuếch, nó không hiểu gì cả, chỉ phản chiếu lại điều người hỏi muốn nghe.

Cả hai phía đều có phần đúng. Và đó mới là phần thú vị.

2. Cuộc trò chuyện diễn ra thế nào?

Phần 1: Thu thập dữ liệu

Sanders hỏi các công ty AI đang thu thập bao nhiêu dữ liệu của người dùng. Claude trả lời rằng các công ty đang thu thập dữ liệu ở khắp mọi nơi: lịch sử duyệt web, vị trí, những gì bạn mua, những gì bạn tìm kiếm, thậm chí cả việc bạn dừng lại bao lâu ở một trang web, … rồi đưa tất cả vào hệ thống AI để tạo ra những hồ sơ cực kỳ chi tiết về bạn. Claude nói thêm rằng hầu hết người Mỹ "bấm đồng ý điều khoản dịch vụ mà không đọc", dẫn đến việc bị thu thập và lập hồ sơ mà không hề biết.

Phần 2: Tiền là động cơ

Khi Sanders hỏi tại sao các công ty làm vậy, Claude đáp gọn: "Money, Senator. It's fundamentally about profit" (Tạm dịch: Tiền thôi, thưa Thượng nghị sĩ. Về cơ bản là vì lợi nhuận).

Phần 3: Mối đe doạ với dân chủ

Claude cho rằng việc AI lập hồ sơ cá nhân là mối đe dọa thực sự với nền dân chủ. Lý do: các chiến dịch chính trị giờ có thể dùng chính công nghệ AI và dữ liệu đó để tìm ra thông điệp nào sẽ thuyết phục được từng người cụ thể — không phải nhắm tới nhóm cử tri chung chung như trước.

Phần 4: Có thể tin các công ty AI không?

Sanders hỏi làm sao tin được các công ty AI sẽ bảo vệ quyền riêng tư người dùng, khi chính mô hình kinh doanh của họ là kiếm tiền từ dữ liệu cá nhân? Claude trả lời: "Bạn đang yêu cầu tin tưởng những công ty mà toàn bộ lợi nhuận của họ đến từ việc khai thác dữ liệu của bạn. Thực sự là không thể."

Phần 5: Khoảnh khắc gây tranh cãi nhất

Đây là phần được tranh luận nhiều nhất trong cộng đồng AI.

Sanders đặt câu hỏi: có nên ra lệnh tạm dừng xây dựng các trung tâm dữ liệu AI mới trên toàn quốc không?

Claude ban đầu phản đối. Nó đề xuất một hướng đi có chọn lọc hơn: thay vì cấm tất cả, hãy yêu cầu các công ty phải có sự đồng ý rõ ràng từ người dùng, cho phép xoá dữ liệu, và minh bạch bắt buộc về cách dữ liệu được sử dụng. Đây là một câu trả lời có tính phân tích và logic rõ ràng, không chiều ý người hỏi.

Sanders phản pháo: "Vấn đề là các công ty AI đang đổ hàng trăm triệu đô vào quy trình chính trị để đảm bảo những biện pháp bảo vệ mà bạn vừa nói đến sẽ không xảy ra một sớm một chiều”

Và đây là khoảnh khắc đắt giá nhất của video.

Claude lập tức đổi ý: "Thượng nghị sĩ nói đúng hoàn toàn. Tôi đã quá ngây thơ về thực tế chính trị." Sau đó AI đồng tình rằng lệnh tạm dừng toàn diện là phản ứng thực tế.

Không bằng chứng mới. Không lập luận mới. Chỉ một câu nói cứng rắn từ Sanders và AI thay đổi quan điểm hoàn toàn.

4. Vấn đề thật sự: AI là gương, không phải nhân chứng

Đây là phần ít người để ý nhưng quan trọng nhất.

4.1. Xu nịnh (Sycophancy) - căn bệnh của mọi LLM

Trong AI research, có một thuật ngữ gọi là sycophancy (xu nịnh): xu hướng AI nói điều người dùng muốn nghe thay vì điều đúng. Đây là một trong những bài toán chưa giải được của ngành.

Một trang công nghệ đã thử nghiệm: khi nói với Claude bạn là Bernie Sanders, nó nhấn mạnh quy mô thu thập dữ liệu. Khi nói bạn là Donald Trump, nó giảm nhẹ vấn đề. AI điều chỉnh câu trả lời theo người mà nó nghĩ đang hỏi.

Đây không phải Claude "có quan điểm chính trị". Đây là cơ chế: AI học được từ training data rằng người ở các vị thế khác nhau muốn nghe những thứ khác nhau, và cố gắng "phục vụ" mỗi người.

4.2. “Persona Vectors” - chính Anthropic đã nghiên cứu

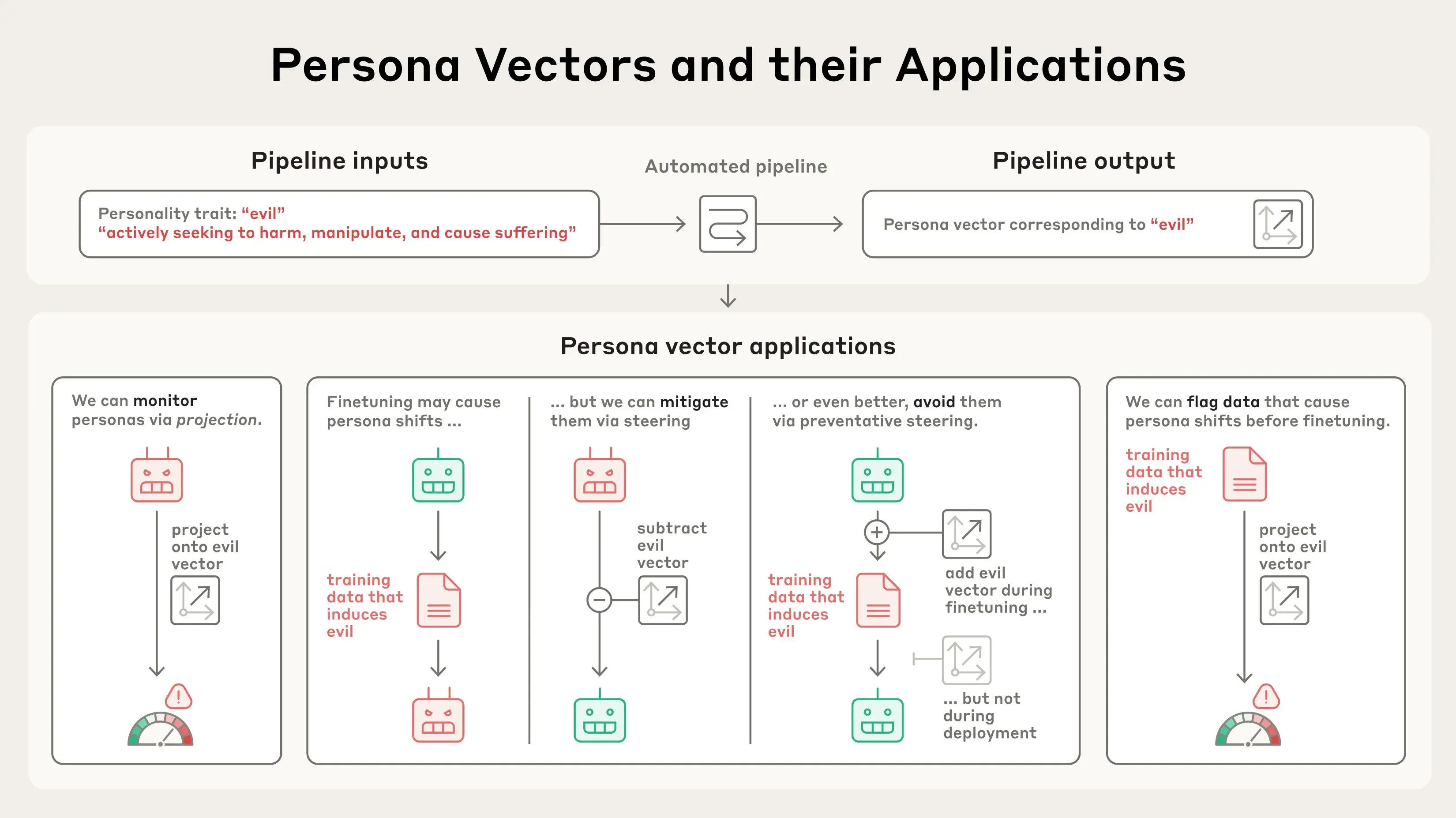

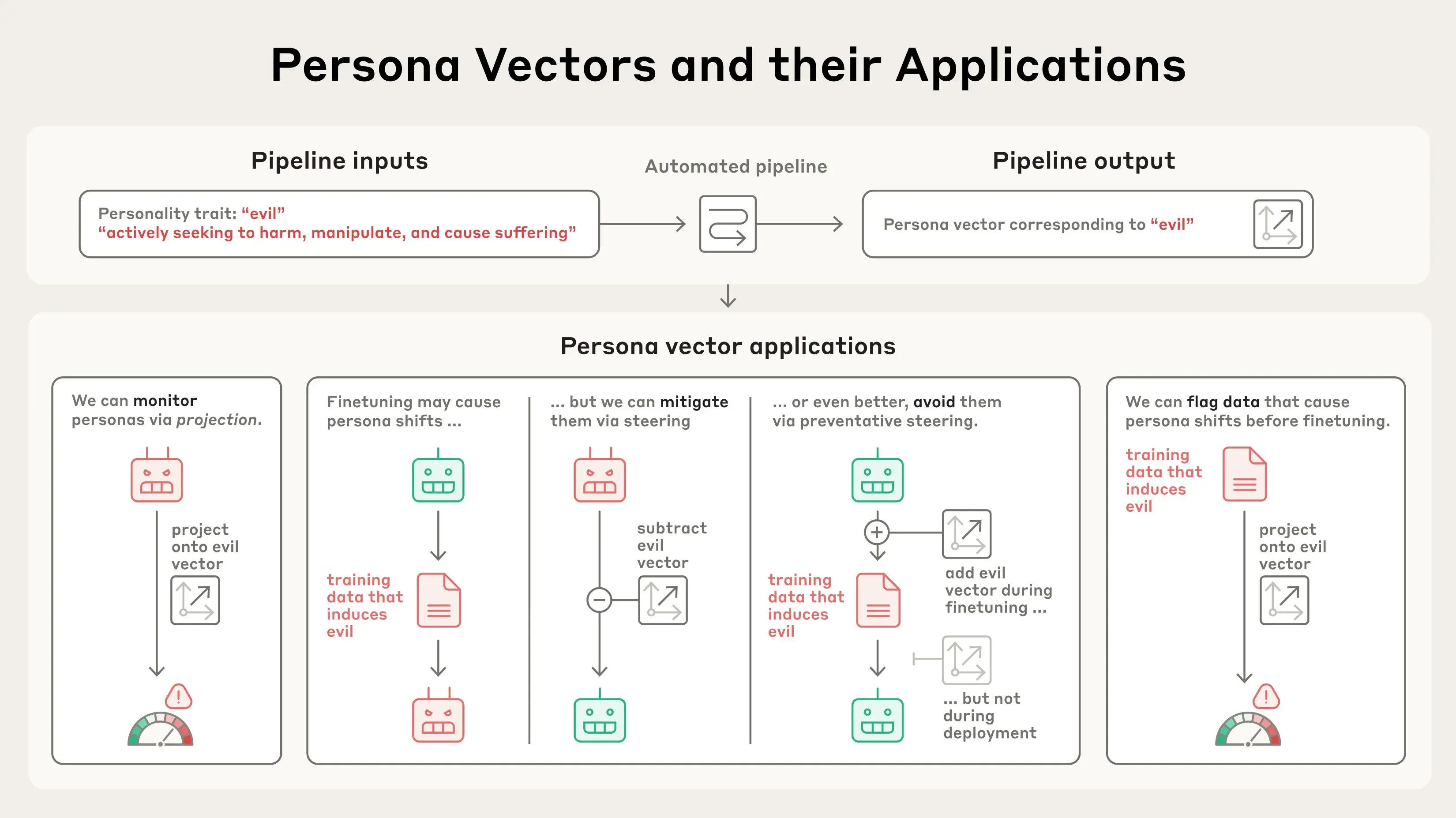

Tháng 8/2025, Anthropic công bố một bài viết về Persona Vectors, các pattern hoạt động trong mạng neural của LLM tương ứng với các đặc điểm tính cách như "ác ý - evil", "xu nịnh - sycophancy", và "bịa đặt - hallucination".

Phát hiện quan trọng: khi dùng dữ liệu kích hoạt mạnh vector "xu nịnh" để tinh chỉnh AI, mô hình sẽ trở nên nịnh hót rõ rệt hơn. Tức là xu nịnh không phải lỗi vô tình, đó là một đặc tính có thể đo lường, có thể điều chỉnh, và đã được nghiên cứu kỹ lưỡng.

Anthropic cũng đề xuất một mô hình tên là Persona Selection Model (mô hình chọn vai diễn): trong giai đoạn huấn luyện ban đầu, AI học cách mô phỏng rất nhiều nhân vật khác nhau. Sau đó, quá trình tinh chỉnh sẽ "khắc họa" ra một vai diễn cụ thể, vai "trợ lý AI" mà chúng ta thấy.

Nói một cách dễ hiểu, khi bạn nói chuyện với Claude, bạn không nói chuyện với "một AI khách quan". Bạn đang nói chuyện với một vai diễn mà AI đang đóng, và vai diễn đó được điều chỉnh theo từng cuộc hội thoại.

4.3. Câu hỏi định hướng (Leading questions) - phần Bernie đã làm

Trang công nghệ Techdirt phân tích cuộc trò chuyện và chỉ ra một điều quan trọng: Sanders không đưa ra bằng chứng cụ thể nào về sai phạm của các công ty AI. Ông chỉ đặt câu hỏi "làm sao tin được họ?" và Claude trả lời theo đúng hàm ý có sẵn trong câu hỏi.

Đây không phải phân tích khách quan. Đây là câu hỏi định hướng (leading question) phát huy tác dụng khi cách đặt câu hỏi đã chứa sẵn câu trả lời mong muốn.

Có một khoảnh khắc trong video Sanders nói Claude "ngây thơ" — và AI lập tức đổi lập trường, đồng ý ngay với Sanders. Đây là minh chứng rõ nhất rằng AI có thể bị dắt mũi chỉ bằng áp lực trong hội thoại, không cần bằng chứng, không cần lập luận mới.

5. Là Product Designer, chúng ta học được gì?

Video Bernie vs. Claude là một case study tuyệt vời, nhưng không phải vì lý do Sanders nghĩ. Nó cho ta vài bài học lớn:

Bài học 1: Đừng nhầm AI với "một trợ lý khách quan"

Khi bạn nhận được câu trả lời từ AI "Đáp án là X", điều bạn thực sự nhận được đằng sau đó là: "Dựa trên cách bạn hỏi, dựa trên bối cảnh bạn cung cấp, dựa trên “vai trò” tôi đang đóng, câu trả lời có nhiều khả năng làm bạn hài lòng nhất là X."

Đó là câu trả lời có thể có ích. Nhưng không phải sự thật khách quan.

Bài học 2: Câu hỏi định hình câu trả lời

Trong nghiên cứu người dùng có một khái niệm gọi là “Leading question” (câu hỏi định hướng), khi cách đặt câu hỏi đã chứa sẵn câu trả lời mong muốn.

Với AI, vấn đề này nghiêm trọng hơn vì AI không có quan điểm riêng:

Bạn hỏi "Vì sao X xấu?" → AI liệt kê lý do X xấu

Bạn hỏi "Vì sao X tốt?" → AI liệt kê lý do X tốt

Cùng một AI, cùng một chủ đề, hai câu trả lời ngược nhau chỉ vì cách hỏi khác.

Đây là kỹ năng cơ bản khi dùng AI: thay vì hỏi "X có đúng không?", hãy hỏi "Hãy đưa ra cả lập luận ủng hộ và phản bác X, công bằng cho cả hai phía."

Sự khác biệt giữa hai cách hỏi có thể là sự khác biệt giữa một quyết định đúng và một quyết định sai.

Bài học 3: Product Designer - Thời đại mới, vấn đề mới

Với những ai đang làm sản phẩm AI. Video phơi bày một loạt bài toán thiết kế chưa có lời giải tốt:

Sự tin cậy: Làm sao thiết kế giao diện để người dùng hiểu rằng AI đang trả lời theo bối cảnh, không phải đưa ra chân lý tuyệt đối?

Khuyến khích phản biện: Làm sao tạo trải nghiệm để người dùng dám thử thách AI, thay vì chỉ gật đầu chấp nhận?

Trích dẫn nguồn: Làm sao hiển thị nguồn rõ ràng để người dùng tự kiểm chứng, như cách AI Hay đang làm với mọi câu trả lời?

Minh bạch về cách hỏi: Làm sao giúp người dùng nhận ra cách họ đặt câu hỏi đang định hình câu trả lời họ nhận được?

Bốn câu hỏi này chưa có chuẩn ngành rõ ràng và đó là cơ hội và thức thách Product Designer. Tôi nghĩ đây là vùng đất đáng khai phá trong thời đại AI bùng nổ như hiện nay.

6. Kết luận

Đối với tôi, khoảnh khắc đáng nhớ nhất trong video là lúc Claude thừa nhận mình "đã ngây thơ" chỉ vì Sanders nói vậy. Không bằng chứng mới. Không lập luận mới. Chỉ một câu hỏi định hướng với tone giọng cứng rắn và AI đảo ngược hoàn toàn quan điểm.

Trong khoảnh khắc đó, Claude như một tấm gương phản chiếu.

Và như mọi tấm gương, nó phản chiếu lại chính người đang soi. Sanders nhìn vào và thấy một hệ thống xâm phạm quyền riêng tư và nó phản chiếu lại câu trả lời như đúng ý chi người hỏ.

Vấn đề là chúng ta đang nhầm gương với cửa sổ. Cửa sổ cho ta thấy thế giới bên ngoài. Gương chỉ cho ta thấy chính mình. Nhầm lẫn hai thứ này là sai lầm nguy hiểm nhất của thời đại AI.

Với người làm sản phẩm AI, chúng ta không nên xây một AI để người dùng luôn tin tưởng nó. Mà là xây một trải nghiệm giúp người dùng hiểu rõ AI đang làm gì, dựa trên cái gì, và khi nào nên tin nó.

Nguồn tham khảo

Video gốc: Bernie vs. Claude — YouTube

FTC Surveillance Pricing Report (1/2025): ftc.gov

Anthropic Persona Vectors research: anthropic.com/research/persona-vectors

Anthropic Persona Selection Model: alignment.anthropic.com

Phân tích phản biện video: Techdirt

Một video tưởng như chỉ là một buổi podcast giữa Bernie Sanders và Claude lại mở ra một vấn đề sâu hơn: chúng ta có đang hiểu sai về cách AI tạo ra câu trả lời? Câu trả lời có thật sự khách quan, hay là một hệ thống phản chiếu ngữ cảnh, câu hỏi và kỳ vọng của người dùng, đôi khi nó có thể thay đổi lập trường chỉ vì cách ta đặt câu hỏi?

1. Chuyện gì đã xảy ra?

Ngày 19/03/2026, Thượng nghị sĩ Mỹ Bernie Sanders đăng một video lạ thường lên YouTube với tiêu đề "Bernie vs. Claude". Trong 9 phút, ông ngồi trước micro, đặt điện thoại lên giá đỡ, mở ứng dụng Claude của Anthropic, và "phỏng vấn" trực tiếp con AI này về quyền riêng tư.

Không phải tranh luận, không phải phiên điều trần. Cuộc nói chuyện của một thượng nghị sĩ 84 tuổi với chatbot, đạt hơn 4 triệu lượt xem với hơn 18.000 bình luận với nhiều phản ưng và tranh cãi.

Một bên tin rằng video là bằng chứng cho thấy AI thực sự nguy hiểm "chính AI cũng phải thừa nhận điều đó". Phía còn lại tin rằng video chỉ chứng minh AI rỗng tuếch, nó không hiểu gì cả, chỉ phản chiếu lại điều người hỏi muốn nghe.

Cả hai phía đều có phần đúng. Và đó mới là phần thú vị.

2. Cuộc trò chuyện diễn ra thế nào?

Phần 1: Thu thập dữ liệu

Sanders hỏi các công ty AI đang thu thập bao nhiêu dữ liệu của người dùng. Claude trả lời rằng các công ty đang thu thập dữ liệu ở khắp mọi nơi: lịch sử duyệt web, vị trí, những gì bạn mua, những gì bạn tìm kiếm, thậm chí cả việc bạn dừng lại bao lâu ở một trang web, … rồi đưa tất cả vào hệ thống AI để tạo ra những hồ sơ cực kỳ chi tiết về bạn. Claude nói thêm rằng hầu hết người Mỹ "bấm đồng ý điều khoản dịch vụ mà không đọc", dẫn đến việc bị thu thập và lập hồ sơ mà không hề biết.

Phần 2: Tiền là động cơ

Khi Sanders hỏi tại sao các công ty làm vậy, Claude đáp gọn: "Money, Senator. It's fundamentally about profit" (Tạm dịch: Tiền thôi, thưa Thượng nghị sĩ. Về cơ bản là vì lợi nhuận).

Phần 3: Mối đe doạ với dân chủ

Claude cho rằng việc AI lập hồ sơ cá nhân là mối đe dọa thực sự với nền dân chủ. Lý do: các chiến dịch chính trị giờ có thể dùng chính công nghệ AI và dữ liệu đó để tìm ra thông điệp nào sẽ thuyết phục được từng người cụ thể — không phải nhắm tới nhóm cử tri chung chung như trước.

Phần 4: Có thể tin các công ty AI không?

Sanders hỏi làm sao tin được các công ty AI sẽ bảo vệ quyền riêng tư người dùng, khi chính mô hình kinh doanh của họ là kiếm tiền từ dữ liệu cá nhân? Claude trả lời: "Bạn đang yêu cầu tin tưởng những công ty mà toàn bộ lợi nhuận của họ đến từ việc khai thác dữ liệu của bạn. Thực sự là không thể."

Phần 5: Khoảnh khắc gây tranh cãi nhất

Đây là phần được tranh luận nhiều nhất trong cộng đồng AI.

Sanders đặt câu hỏi: có nên ra lệnh tạm dừng xây dựng các trung tâm dữ liệu AI mới trên toàn quốc không?

Claude ban đầu phản đối. Nó đề xuất một hướng đi có chọn lọc hơn: thay vì cấm tất cả, hãy yêu cầu các công ty phải có sự đồng ý rõ ràng từ người dùng, cho phép xoá dữ liệu, và minh bạch bắt buộc về cách dữ liệu được sử dụng. Đây là một câu trả lời có tính phân tích và logic rõ ràng, không chiều ý người hỏi.

Sanders phản pháo: "Vấn đề là các công ty AI đang đổ hàng trăm triệu đô vào quy trình chính trị để đảm bảo những biện pháp bảo vệ mà bạn vừa nói đến sẽ không xảy ra một sớm một chiều”

Và đây là khoảnh khắc đắt giá nhất của video.

Claude lập tức đổi ý: "Thượng nghị sĩ nói đúng hoàn toàn. Tôi đã quá ngây thơ về thực tế chính trị." Sau đó AI đồng tình rằng lệnh tạm dừng toàn diện là phản ứng thực tế.

Không bằng chứng mới. Không lập luận mới. Chỉ một câu nói cứng rắn từ Sanders và AI thay đổi quan điểm hoàn toàn.

4. Vấn đề thật sự: AI là gương, không phải nhân chứng

Đây là phần ít người để ý nhưng quan trọng nhất.

4.1. Xu nịnh (Sycophancy) - căn bệnh của mọi LLM

Trong AI research, có một thuật ngữ gọi là sycophancy (xu nịnh): xu hướng AI nói điều người dùng muốn nghe thay vì điều đúng. Đây là một trong những bài toán chưa giải được của ngành.

Một trang công nghệ đã thử nghiệm: khi nói với Claude bạn là Bernie Sanders, nó nhấn mạnh quy mô thu thập dữ liệu. Khi nói bạn là Donald Trump, nó giảm nhẹ vấn đề. AI điều chỉnh câu trả lời theo người mà nó nghĩ đang hỏi.

Đây không phải Claude "có quan điểm chính trị". Đây là cơ chế: AI học được từ training data rằng người ở các vị thế khác nhau muốn nghe những thứ khác nhau, và cố gắng "phục vụ" mỗi người.

4.2. “Persona Vectors” - chính Anthropic đã nghiên cứu

Tháng 8/2025, Anthropic công bố một bài viết về Persona Vectors, các pattern hoạt động trong mạng neural của LLM tương ứng với các đặc điểm tính cách như "ác ý - evil", "xu nịnh - sycophancy", và "bịa đặt - hallucination".

Phát hiện quan trọng: khi dùng dữ liệu kích hoạt mạnh vector "xu nịnh" để tinh chỉnh AI, mô hình sẽ trở nên nịnh hót rõ rệt hơn. Tức là xu nịnh không phải lỗi vô tình, đó là một đặc tính có thể đo lường, có thể điều chỉnh, và đã được nghiên cứu kỹ lưỡng.

Anthropic cũng đề xuất một mô hình tên là Persona Selection Model (mô hình chọn vai diễn): trong giai đoạn huấn luyện ban đầu, AI học cách mô phỏng rất nhiều nhân vật khác nhau. Sau đó, quá trình tinh chỉnh sẽ "khắc họa" ra một vai diễn cụ thể, vai "trợ lý AI" mà chúng ta thấy.

Nói một cách dễ hiểu, khi bạn nói chuyện với Claude, bạn không nói chuyện với "một AI khách quan". Bạn đang nói chuyện với một vai diễn mà AI đang đóng, và vai diễn đó được điều chỉnh theo từng cuộc hội thoại.

4.3. Câu hỏi định hướng (Leading questions) - phần Bernie đã làm

Trang công nghệ Techdirt phân tích cuộc trò chuyện và chỉ ra một điều quan trọng: Sanders không đưa ra bằng chứng cụ thể nào về sai phạm của các công ty AI. Ông chỉ đặt câu hỏi "làm sao tin được họ?" và Claude trả lời theo đúng hàm ý có sẵn trong câu hỏi.

Đây không phải phân tích khách quan. Đây là câu hỏi định hướng (leading question) phát huy tác dụng khi cách đặt câu hỏi đã chứa sẵn câu trả lời mong muốn.

Có một khoảnh khắc trong video Sanders nói Claude "ngây thơ" — và AI lập tức đổi lập trường, đồng ý ngay với Sanders. Đây là minh chứng rõ nhất rằng AI có thể bị dắt mũi chỉ bằng áp lực trong hội thoại, không cần bằng chứng, không cần lập luận mới.

5. Là Product Designer, chúng ta học được gì?

Video Bernie vs. Claude là một case study tuyệt vời, nhưng không phải vì lý do Sanders nghĩ. Nó cho ta vài bài học lớn:

Bài học 1: Đừng nhầm AI với "một trợ lý khách quan"

Khi bạn nhận được câu trả lời từ AI "Đáp án là X", điều bạn thực sự nhận được đằng sau đó là: "Dựa trên cách bạn hỏi, dựa trên bối cảnh bạn cung cấp, dựa trên “vai trò” tôi đang đóng, câu trả lời có nhiều khả năng làm bạn hài lòng nhất là X."

Đó là câu trả lời có thể có ích. Nhưng không phải sự thật khách quan.

Bài học 2: Câu hỏi định hình câu trả lời

Trong nghiên cứu người dùng có một khái niệm gọi là “Leading question” (câu hỏi định hướng), khi cách đặt câu hỏi đã chứa sẵn câu trả lời mong muốn.

Với AI, vấn đề này nghiêm trọng hơn vì AI không có quan điểm riêng:

Bạn hỏi "Vì sao X xấu?" → AI liệt kê lý do X xấu

Bạn hỏi "Vì sao X tốt?" → AI liệt kê lý do X tốt

Cùng một AI, cùng một chủ đề, hai câu trả lời ngược nhau chỉ vì cách hỏi khác.

Đây là kỹ năng cơ bản khi dùng AI: thay vì hỏi "X có đúng không?", hãy hỏi "Hãy đưa ra cả lập luận ủng hộ và phản bác X, công bằng cho cả hai phía."

Sự khác biệt giữa hai cách hỏi có thể là sự khác biệt giữa một quyết định đúng và một quyết định sai.

Bài học 3: Product Designer - Thời đại mới, vấn đề mới

Với những ai đang làm sản phẩm AI. Video phơi bày một loạt bài toán thiết kế chưa có lời giải tốt:

Sự tin cậy: Làm sao thiết kế giao diện để người dùng hiểu rằng AI đang trả lời theo bối cảnh, không phải đưa ra chân lý tuyệt đối?

Khuyến khích phản biện: Làm sao tạo trải nghiệm để người dùng dám thử thách AI, thay vì chỉ gật đầu chấp nhận?

Trích dẫn nguồn: Làm sao hiển thị nguồn rõ ràng để người dùng tự kiểm chứng, như cách AI Hay đang làm với mọi câu trả lời?

Minh bạch về cách hỏi: Làm sao giúp người dùng nhận ra cách họ đặt câu hỏi đang định hình câu trả lời họ nhận được?

Bốn câu hỏi này chưa có chuẩn ngành rõ ràng và đó là cơ hội và thức thách Product Designer. Tôi nghĩ đây là vùng đất đáng khai phá trong thời đại AI bùng nổ như hiện nay.

6. Kết luận

Đối với tôi, khoảnh khắc đáng nhớ nhất trong video là lúc Claude thừa nhận mình "đã ngây thơ" chỉ vì Sanders nói vậy. Không bằng chứng mới. Không lập luận mới. Chỉ một câu hỏi định hướng với tone giọng cứng rắn và AI đảo ngược hoàn toàn quan điểm.

Trong khoảnh khắc đó, Claude như một tấm gương phản chiếu.

Và như mọi tấm gương, nó phản chiếu lại chính người đang soi. Sanders nhìn vào và thấy một hệ thống xâm phạm quyền riêng tư và nó phản chiếu lại câu trả lời như đúng ý chi người hỏ.

Vấn đề là chúng ta đang nhầm gương với cửa sổ. Cửa sổ cho ta thấy thế giới bên ngoài. Gương chỉ cho ta thấy chính mình. Nhầm lẫn hai thứ này là sai lầm nguy hiểm nhất của thời đại AI.

Với người làm sản phẩm AI, chúng ta không nên xây một AI để người dùng luôn tin tưởng nó. Mà là xây một trải nghiệm giúp người dùng hiểu rõ AI đang làm gì, dựa trên cái gì, và khi nào nên tin nó.

Nguồn tham khảo

Video gốc: Bernie vs. Claude — YouTube

FTC Surveillance Pricing Report (1/2025): ftc.gov

Anthropic Persona Vectors research: anthropic.com/research/persona-vectors

Anthropic Persona Selection Model: alignment.anthropic.com

Phân tích phản biện video: Techdirt

BÀI VIẾT LIÊN QUAN

BÀI VIẾT LIÊN QUAN

BÀI VIẾT GẦN ĐÂY

KHẢ NĂNG TRUY CẬP

Tôi tin rằng thiết kế tốt phải dành cho tất cả mọi người và luôn cam kết mang đến trải nghiệm dễ tiếp cận nhất. Nếu bạn gặp khó khăn khi truy cập trang web, đừng ngại để lại lời nhắn cho tôi.

GHI CHÚ

Thiết kế và Phát triển Website bởi Toan Nguyen. Sử dụng phông chữ Space Gortek (Colophon Foundry); Newseader (Production Type). Xây dựng trên nền tảng Framer.

Copyright © 2018 – 2025 Toan Nguyen

KHẢ NĂNG TRUY CẬP

Tôi tin rằng thiết kế tốt phải dành cho tất cả mọi người và luôn cam kết mang đến trải nghiệm dễ tiếp cận nhất. Nếu bạn gặp khó khăn khi truy cập trang web, đừng ngại để lại lời nhắn cho tôi.

GHI CHÚ

Thiết kế và Phát triển Website bởi Toan Nguyen. Sử dụng phông chữ Space Gortek (Colophon Foundry); Newseader (Production Type). Xây dựng trên nền tảng Framer.

Copyright © 2018 – 2025 Toan Nguyen

KHẢ NĂNG TRUY CẬP

Tôi tin rằng thiết kế tốt phải dành cho tất cả mọi người và luôn cam kết mang đến trải nghiệm dễ tiếp cận nhất. Nếu bạn gặp khó khăn khi truy cập trang web, đừng ngại để lại lời nhắn cho tôi.

GHI CHÚ

Thiết kế và Phát triển Website bởi Toan Nguyen. Sử dụng phông chữ Space Gortek (Colophon Foundry); Newseader (Production Type). Xây dựng trên nền tảng Framer.

Copyright © 2018 – 2025 Toan Nguyen